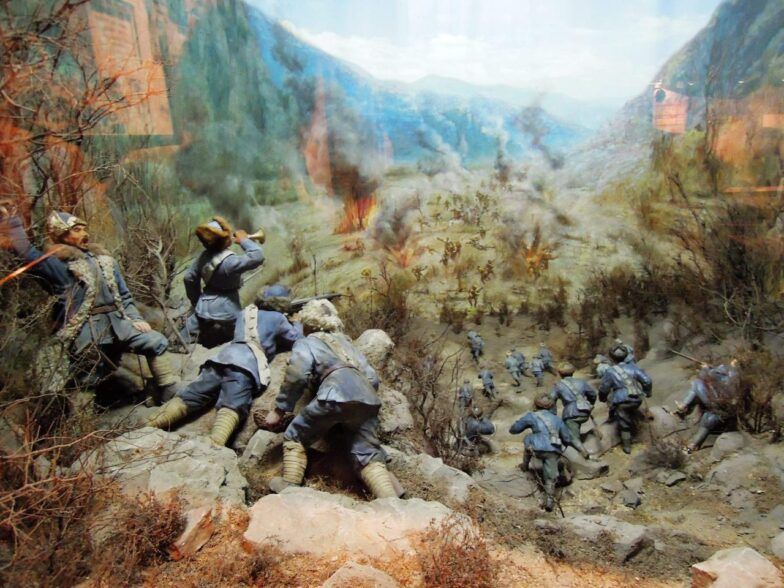

过去几年,人们对将机器人纳入安全、治安和军事行动的兴趣一直在稳步增长。北美和欧洲已经在探索这一途径。

机器人融入这些领域可以被视为类似于 20 世纪狗在警务和军队中的角色。狗充当警卫、哨兵、信息携带者和探雷器等角色。

![图片[1]-人工智能已经与机器人技术融合——结果之一可能是强大的新武器-小师评](https://img01.xiaoshiping.cn/xsp-bucket/2023/11/20231129142740808.jpg)

旨在为人类提供支持作用的实用机器人不仅在形式上,而且在功能上都在模仿我们的四足伙伴。它们配备了监视技术,能够作为补给链的一部分运送设备、弹药等,可以大大减少战场上人类士兵受伤的风险。

然而,如果增加武器系统,多功能机器人无疑将呈现出不同的面貌。本质上,它们将成为美国军方目前使用的MQ-9 捕食者无人机的陆基变体。

2021 年,Ghost Robotics 公司展示了他们的一款名为 Q-UGV 的四足机器人,该机器人配备了特殊用途无人步枪 4。此次展示活动重点关注实用机器人的武器化。

重要的是要注意武器和机器人技术融合的各个方面如何以不同的方式运作。虽然机器人本身是半自主的,可以远程控制,但安装的武器没有自主能力,完全由操作员控制。

2023 年 9 月,美国海军陆战队对另一个四足实用机器人进行了概念验证测试。他们测量了其“使用 M72 轻型反坦克武器捕获和起诉目标”的能力。

这次测试重新引发了关于在战争中使用自动化和半自动化武器系统的道德争论。对于这些平台中的任何一个来说,整合人工智能驱动的威胁检测和“锁定”目标的能力都不会是一个很大的进步。事实上,这种性质的瞄准系统已经在公开市场上出售。

2022 年,十几家领先的机器人公司在波士顿动力公司的网站上签署了一封公开信,该公司创造了一款名为 Spot 的类似狗的实用机器人。在信中,这些公司反对将商用机器人武器化。

![图片[2]-人工智能已经与机器人技术融合——结果之一可能是强大的新武器-小师评](https://img01.xiaoshiping.cn/xsp-bucket/2023/11/20231129142743785.jpg)

然而,信中还表示,这些公司并没有对“国家及其政府机构用来保卫自己和维护法律的现有技术”提出异议。在这一点上,值得思考的是,人工智能武器化是否已经开始了。集成了机器人技术的智能技术的武器系统已经在战斗中使用。

本月,波士顿动力公司发布了一段视频,展示了该公司如何将人工智能聊天机器人 ChatGPT 添加到其 Spot 机器人中。可以看到,该机器使用几种不同的“个性”(例如英国管家)来回答公司一位工程师的问题和对话。回应来自人工智能聊天机器人,但 Spot 却用口型说出了这句话。

对于整个行业来说,这是令人着迷的一步,而且可能也是积极的一步。尽管波士顿动力公司可能会恪守不将机器人武器化的承诺,但其他公司可能不会这么想。缺乏道德指南针的个人或机构也有可能滥用此类机器人。正如公开信所暗示的那样:“如果可能,我们将仔细审查客户的预期应用,以避免潜在的武器化。”

英国的立场

英国已经在 2022 年发布的《国防人工智能战略》中就人工智能武器化表明了立场。该文件表达了将人工智能快速整合到国防部系统中的意图,以加强安全和实现武装部队现代化。

然而值得注意的是,该战略文件的附件特别认识到与致命自主武器系统相关的潜在挑战。

![图片[3]-人工智能已经与机器人技术融合——结果之一可能是强大的新武器-小师评](https://img01.xiaoshiping.cn/xsp-bucket/2023/11/20231129142745910.jpg)

例如,现实世界的数据用于“训练”人工智能系统或改进它们。通过 ChatGPT,这是从互联网收集的。虽然它有助于人工智能系统变得更加有用,但所有“现实世界”信息也可能会将有缺陷的假设和偏见传递给系统本身。这可能会导致算法偏差(人工智能偏爱一组或选项而不是另一组)或人工智能做出不适当和不成比例的响应。因此,需要在考虑道德战的情况下仔细审查武器系统的样本训练数据。

今年,上议院成立了武器系统人工智能特别委员会。其目的是了解武装部队如何从技术进步中获益,同时通过实施技术、法律和道德保障措施将风险降至最低。英国政策和国际决策的充分性也在接受审查。

机器狗还没有将武器瞄准敌方力量。但如果不加以控制,这一场景成为现实的所有要素都已存在。人工智能和机器人技术的快速发展正在掀起一场完美风暴,可能会带来强大的新武器。

最近在布莱奇利公园举行的人工智能安全峰会为英国和国际上的人工智能监管取得了积极成果。然而,有迹象表明峰会目标与武器系统人工智能委员会的目标之间存在哲学分歧。

此次峰会旨在定义人工智能,评估其能力和局限性,并就其道德使用达成全球共识。它试图通过一份声明来做到这一点,就像波士顿动力公司的公开信一样。然而,两者都不具有约束力。该委员会力求明确、快速地整合该技术,同时遵守道德、法规和国际法。

布莱奇利峰会和宣言中频繁使用“护栏”一词表明自愿承诺。而英国首相苏纳克则表示,各国不应急于监管。